Актуальные темы

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

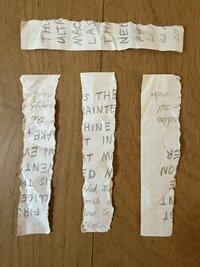

ChatGPT o3-pro идентифицирует цитату И. Дж. Гуда 1965 года, написанную от руки смесью печатного и скорописного текста на записке, разорванной на четыре полосы в обратном порядке, повернутой на 90° в чередующихся направлениях:

… И снова, с теми же полосками скомканными, сплющенными вручную, и расположенными иначе:

Однако более жесткие вариации с окклюзией предметов домашнего обихода не увенчались успехом — в одном случае они дали ироническое опровержение фактически написанному тексту:

Обратите внимание, что реальное судебно-экспертное программное обеспечение гораздо мощнее, чем это, и может "восстанавливать" многопстраничные документы, пропущенные через обычные офисные шредеры, после тщательного сканирования.

Это скорее новинка — это интересно только потому, что оно не было разработано для выполнения этой задачи.

Обратите внимание, что реальное программное обеспечение для криминалистической экспертизы намного мощнее этого и может «разбивать» многостраничные документы, прогоняемые через типичные офисные шредеры после тщательного сканирования.

Это скорее новинка — она интересна, потому что она не была предназначена для этого.

@virtualdigit @emollick Скорее всего, нет:

7 июл. 2025 г.

Обратите внимание, что реальное программное обеспечение для криминалистической экспертизы намного мощнее этого и может «разбивать» многостраничные документы, прогоняемые через типичные офисные шредеры после тщательного сканирования.

Это скорее новинка — она интересна, потому что она не была предназначена для этого.

В нескольких ответах был задан вопрос о том, в какой степени модель исправляет ошибку в известном тексте цитаты (подразумевая, что она может не обобщать его так же хорошо, как и новый текст).

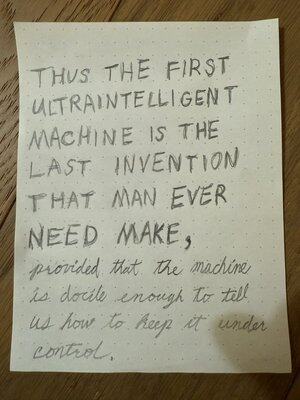

Непреднамеренная ошибка в моей заметке предполагает, что это действительно происходит — в моей написано «всегда нужно», а не «нужно когда-либо», как писал Гуд:

@ShaulGoo Не в этом случае, но, учитывая мою конкретную подсказку, игнорирование мелких ошибок, возможно, является правильным поведением.

Смотрите этот ответ, который я только что добавил в тему:

7 июл. 2025 г.

В нескольких ответах был задан вопрос о том, в какой степени модель исправляет ошибку в известном тексте цитаты (подразумевая, что она может не обобщать его так же хорошо, как и новый текст).

Непреднамеренная ошибка в моей заметке предполагает, что это действительно происходит — в моей написано «всегда нужно», а не «нужно когда-либо», как писал Гуд:

(Хотя я бы поспорил за мою конкретную подсказку, которая подразумевает, что это цитата, а не повторять мелкие ошибки при вводе — это хорошее поведение.)

@panoskalos я сам не пробовал, но вижу здесь:

7 июл. 2025 г.

Что действительно интересно, так это то, что @GeminiApp также может делать то же самое, но для этого требуется немного измененная подсказка@goodside

Я использую 2.5 Pro

@panoskalos @panoskalos Я обновил основную ветку выше, добавив больше результатов от Gemini.

253,8K

Топ

Рейтинг

Избранное