Tópicos populares

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

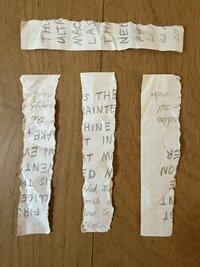

ChatGPT o3-pro identifica uma citação de 1965 de I. J. Good escrita à mão em uma mistura de impressão e cursiva em uma nota rasgada em quatro tiras em ordem inversa girada 90° em direções alternadas:

… e novamente, com as mesmas tiras amassadas, achatadas à mão e dispostas de forma diferente:

Variações mais difíceis caracterizando oclusões por objetos domésticos, no entanto, não foram bem-sucedidas – em um caso, rendendo uma refutação irônica ao texto realmente escrito:

Note que o software forense do mundo real é muito mais poderoso do que isso e pode "destruir" documentos de várias páginas que passaram por trituradores de escritório típicos após uma cuidadosa digitalização.

Isto é mais uma novidade—é interessante apenas porque não foi projetado para conseguir fazer isso.

Observe que o software forense do mundo real é muito mais poderoso do que isso e pode "destruir" documentos de várias páginas executados através de trituradores típicos de escritório após uma verificação cuidadosa.

Isso é mais uma novidade – é interessante porque não foi projetado para fazer isso.

@virtualdigit @emollick Provavelmente não:

7/07/2025

Observe que o software forense do mundo real é muito mais poderoso do que isso e pode "destruir" documentos de várias páginas executados através de trituradores típicos de escritório após uma verificação cuidadosa.

Isso é mais uma novidade – é interessante porque não foi projetado para fazer isso.

Algumas respostas perguntaram até que ponto o modelo corrige erros ao texto conhecido da citação (o que implica que pode não generalizar tão bem para o texto novo).

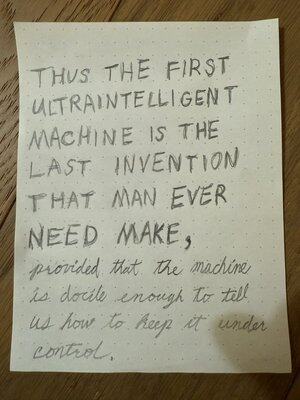

Um erro não intencional em minha nota sugere que isso está realmente acontecendo – o meu lê "sempre precisa", não "precisa nunca", como Good escreveu:

@ShaulGoo Não neste caso, mas dado o meu aviso específico aqui, ignorar pequenos erros é indiscutivelmente o comportamento certo.

Veja esta resposta que acabei de adicionar ao tópico:

7/07/2025

Algumas respostas perguntaram até que ponto o modelo corrige erros ao texto conhecido da citação (o que implica que pode não generalizar tão bem para o texto novo).

Um erro não intencional em minha nota sugere que isso está realmente acontecendo – o meu lê "sempre precisa", não "precisa nunca", como Good escreveu:

(Embora, eu argumentaria para o meu prompt particular, o que implica que é conhecido por ser uma citação, não ecoar pequenos erros na entrada é um bom comportamento.)

@panoskalos Eu não tentei a mim mesmo, mas veja aqui:

7/07/2025

O que é realmente interessante é que @GeminiApp também pode fazer a mesma coisa, mas precisa de um prompt ligeiramente ajustado @goodside

Estou executando 2.5 Pro

@panoskalos @panoskalos Eu atualizei o tópico principal acima com mais resultados de Gêmeos.

253,8K

Top

Classificação

Favoritos