Trend-Themen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

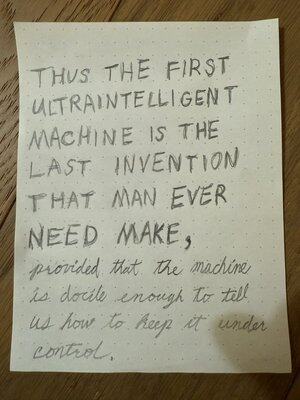

ChatGPT o3-pro identifiziert ein Zitat von I. J. Good aus dem Jahr 1965, handgeschrieben in einer Mischung aus Druck und Schreibschrift auf einer Notiz, die in vier Streifen in umgekehrter Reihenfolge zerrissen ist, die um 90° in abwechselnde Richtungen gedreht sind:

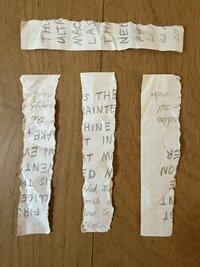

… und wieder, mit denselben Streifen, zerknüllt, von Hand plattgedrückt und anders angeordnet:

Härtere Varianten mit Verschlüssen durch Haushaltsgegenstände waren jedoch nicht erfolgreich – in einem Fall führten sie zu einer ironischen Widerlegung des eigentlich geschriebenen Textes:

Beachten Sie, dass echte forensische Software viel leistungsfähiger ist als dies und in der Lage ist, mehrseitige Dokumente, die durch typische Büroschredder gelaufen sind, nach sorgfältigem Scannen zu "entwirren".

Das ist eher eine Neuheit – es ist nur interessant, weil es nicht dafür entworfen wurde, dies tun zu können.

Beachten Sie, dass reale Forensik-Software viel leistungsfähiger ist als diese und mehrseitige Dokumente nach sorgfältigem Scannen durch typische Aktenvernichter im Büro laufen lassen kann.

Das ist eher eine Neuheit – es ist interessant, weil es nicht dafür konzipiert wurde.

@virtualdigit @emollick Wahrscheinlich nicht:

7. Juli 2025

Beachten Sie, dass reale Forensik-Software viel leistungsfähiger ist als diese und mehrseitige Dokumente nach sorgfältigem Scannen durch typische Aktenvernichter im Büro laufen lassen kann.

Das ist eher eine Neuheit – es ist interessant, weil es nicht dafür konzipiert wurde.

In einigen Antworten wurde gefragt, inwieweit das Modell den bekannten Text des Zitats korrigiert (was bedeutet, dass es möglicherweise nicht so gut auf einen neuartigen Text verallgemeinert werden kann).

Ein unbeabsichtigter Fehler in meiner Notiz deutet darauf hin, dass dies tatsächlich geschieht – meine lautet "ever need", nicht "need ever", wie Good schrieb:

@ShaulGoo Nicht in diesem Fall, aber angesichts meiner speziellen Aufforderung hier ist das Ignorieren kleiner Fehler wohl das richtige Verhalten.

Siehe diese Antwort, die ich gerade zum Thread hinzugefügt habe:

7. Juli 2025

In einigen Antworten wurde gefragt, inwieweit das Modell den bekannten Text des Zitats korrigiert (was bedeutet, dass es möglicherweise nicht so gut auf einen neuartigen Text verallgemeinert werden kann).

Ein unbeabsichtigter Fehler in meiner Notiz deutet darauf hin, dass dies tatsächlich geschieht – meine lautet "ever need", nicht "need ever", wie Good schrieb:

(Obwohl ich für meine spezielle Eingabeaufforderung plädieren würde, die impliziert, dass es sich um ein Zitat handelt, ist es ein gutes Verhalten, kleine Fehler in der Eingabe nicht widerzuspiegeln.)

@panoskalos Ich habe es noch nicht selbst versucht, aber siehe hier:

7. Juli 2025

Was wirklich interessant ist, ist, dass @GeminiApp das Gleiche tun können, aber es braucht eine leicht angepasste Eingabeaufforderung, @goodside

Ich verwende 2.5 Pro

@panoskalos @panoskalos habe ich den Hauptthread oben mit weiteren Ergebnissen von Gemini aktualisiert.

253,79K

Top

Ranking

Favoriten