Актуальні теми

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

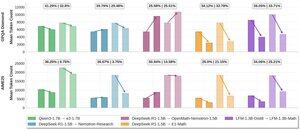

Раді поділитися думками про нашу роботу над ефективними міркуваннями @LiquidAI_ :

Ми перетворюємо модель загального чату 1.3B на сильну математичну аргументацію, яка залишається лаконічною. SFT на кураторських трасах CoT розблоковує сильні міркування та цілеспрямований RL контролює деталізацію.

Рецепт простий і надає цікаву точку даних для моделей, не заснованих на Qwen. Це все ще базується на нашому першому поколінні LFM - ми в захваті від наступного покоління!

Подробиці – у нашому блозі!

@LiquidAI_

4,15K

Найкращі

Рейтинг

Вибране