Rubriques tendance

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

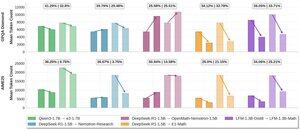

Nous sommes ravis de partager nos idées sur nos travaux sur le raisonnement efficace @LiquidAI_ :

Nous transformons un modèle de chat général 1.3B en un raisonnement mathématique solide qui reste concis. SFT sur des traces CoT organisées débloque un raisonnement solide et une verbosité ciblée des contrôles RL.

La recette est simple et fournit un point de données intéressant pour les modèles non basés sur Qwen. Il s’agit toujours de notre première génération de LFM - nous sommes impatients de découvrir la prochaine génération !

Vous trouverez plus de détails dans notre article de blog !

@LiquidAI_

4,18K

Meilleurs

Classement

Favoris