Rubriques tendance

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

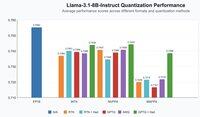

Nous annonçons nos premiers travaux sur l’inférence FP4 pour les LLM !

- QuTLASS : prise en charge du noyau de faible précision pour les GPU Blackwell

- FP-Quet : un harnais de quantification flexible pour Lama/Qwen

Nous atteignons une accélération de 4x par rapport à BF16, avec une bonne précision grâce à la micro-mise à l’échelle MXFP4 + rotations Hadamard fusionnées.

22,57K

Meilleurs

Classement

Favoris