Tendencias del momento

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

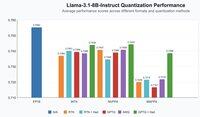

¡Anunciamos nuestro trabajo inicial sobre la inferencia FP4 para LLM!

- QuTLASS: soporte de kernel de baja precisión para GPU Blackwell

- FP-Quant: un arnés de cuantificación flexible para Llama/Qwen

Alcanzamos una aceleración de 4x vs BF16, con buena precisión a través del microescalado MXFP4 + rotaciones de Hadamard fusionadas.

22,57K

Parte superior

Clasificación

Favoritos