Temas en tendencia

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

¡Siempre es bueno ver más trabajo extendiendo Diloco y reduciendo el requisito de ancho de banda para el entrenamiento previo!

22 ago, 10:13

Presentamos SparseLoCo: un método eficiente en la comunicación para el preentrenamiento de LLM.

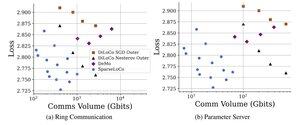

TL; DR: Aprovechamos la esparsificación Top-k + retroalimentación de errores con los pasos externos poco frecuentes de DiLoCo, que comunican solo gradientes del 1 al 3% con cuantificación de 2 bits, superando a DiLoCo y DeMo. 1/N,

ArXiv:

Github:

4.95K

Populares

Ranking

Favoritas