热门话题

#

Bonk 生态迷因币展现强韧势头

#

有消息称 Pump.fun 计划 40 亿估值发币,引发市场猜测

#

Solana 新代币发射平台 Boop.Fun 风头正劲

谁发明了卷积神经网络(CNN)?

1969年:福岛提出了与CNN相关的ReLU。

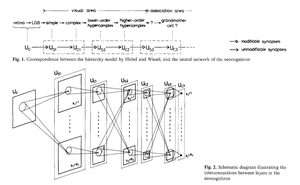

1979年:福岛提出了基本的CNN架构,包括卷积层和下采样层。计算成本比1989年高出100倍,比今天高出10亿倍。

1987年:怀贝尔将林奈恩玛1970年的反向传播应用于具有一维卷积的权重共享TDNN。

1988年:张伟等人将“现代”反向传播训练的二维CNN应用于字符识别。

以上所有内容均在1979年至1988年间在日本发表。

1989年:LeCun等人再次将CNN应用于字符识别(邮政编码)。

1990-93年:福岛基于空间平均的下采样被最大池化替代,适用于一维TDNN(山口等人)和二维CNN(翁等人)。

2011年:更晚些时候,我的团队与丹·西雷森一起使最大池化CNN在NVIDIA GPU上变得非常快速。在2011年,DanNet实现了第一个超人类模式识别结果。曾经一度,它享有垄断地位:从2011年5月到2012年9月,DanNet赢得了它参加的每一个图像识别挑战,连续四次。诚然,这主要是关于工程和扩大前千年的基本见解,利用更快的硬件获利。

一些“人工智能专家”声称“让CNN工作”(例如,参考文献[5,6,9])与发明它们同样重要。但“让它们工作”在很大程度上取决于你的实验室是否足够富有,能够购买最新的计算机以扩大原始工作。这与今天是一样的。基础研究与工程/开发 - R&D中的R与D。

参考文献

[1] K. Fukushima (1979). 不受位置偏移影响的模式识别机制的神经网络模型 - Neocognitron. IECE转会, 第62卷A, 第10期, 第658-665页, 1979年。

[2] K. Fukushima (1969). 通过多层网络的模拟阈值元件进行视觉特征提取. IEEE系统科学与控制论学报. 5 (4): 322-333. 这项工作引入了修正线性单元(ReLU),现在在许多CNN中使用。

[3] S. Linnainmaa (1970). 硕士论文,赫尔辛基大学,1970年。关于“现代”反向传播的第一篇出版物,也称为自动微分的反向模式。(参见施密德胡伯的著名反向传播概述:“谁发明了反向传播?”)

[4] A. Waibel. 使用时间延迟神经网络的音素识别. IEICE会议,东京,日本,1987年。针对具有一维卷积的权重共享TDNN的反向传播。

...

热门

排行

收藏