Rubriques tendance

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Nous pouvons donc maintenant prouver qu'un agent IA a fait ce qu'il prétendait faire !

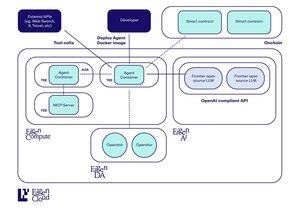

@eigenlayer a lancé deux services qui créent des preuves on-chain. Une pour les sorties IA, une pour le calcul.

C'est important car en ce moment, un agent pourrait exécuter un code complètement différent de celui annoncé et vous ne le sauriez jamais.

Ils ont construit un agent de démonstration qui échange des tokens en fonction du sentiment sur Twitter. C'est open source, donc vous pouvez jeter un œil si vous le souhaitez 👇

En gros, les agents IA auditable sont maintenant réels !

Meilleurs

Classement

Favoris