Subiecte populare

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

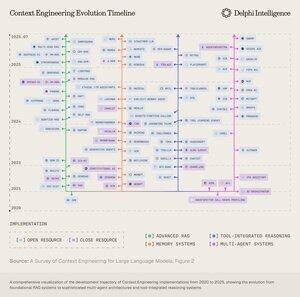

Boop.Fun leading the way with a new launchpad on Solana.

Dacă citiți un lucru săptămâna aceasta, ați sugera raportul AI de mai jos:

"De la turnătorii de date la modele mondiale"

Împletește turnătorii de date, ingineria contextului, mediile RL, modelele mondiale și multe altele într-un eseu abordabil, dar cuprinzător, despre marginea actuală a AI. 👇

Articol complet:

🧵sub:

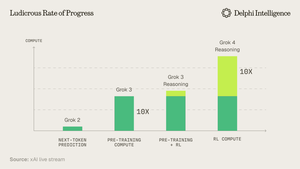

1) Din lansarea Grok 4, este clar că nu ne-am lovit de "un zid" în cheltuielile de calcul.

Sursa: @xai

2) Din ce în ce mai mult, datele par a fi stâlpul scurt din cort.

Sursa: @EpochAIResearch

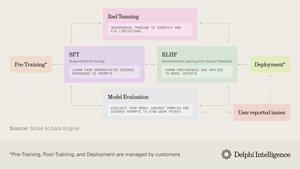

3) Cea mai mare parte a acestor cheltuieli se îndreaptă către generarea de seturi de date de înaltă calitate pentru post-antrenament, care se apropie rapid de 50% din bugetele de calcul

Acest lucru a dus la o inflexiune a cererii de "turnătorii de date" precum @scale_AI @HelloSurgeAI @mercor_ai și multe altele, care ajută la obținerea expertizei necesare și la crearea conductelor de date esențiale pentru RL în domenii neverificabile.

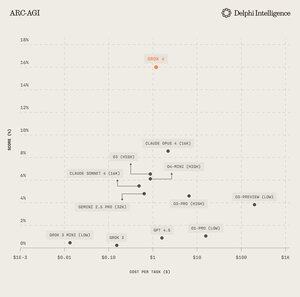

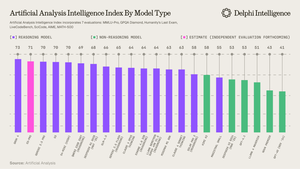

5) Care poate ajuta la alimentarea unor modele de raționament din ce în ce mai capabile, în mod clar paradigma de scalare a zilei per @ArtificialAnlys

6) Și totuși, modelele nu mai sunt constrânse de IQ, ci de context. Ingineria promptă a predat ștafeta "Ingineriei de context" - un domeniu în plină expansiune care optimizează sarcinile utile de informații către LLM-uri.

7) Spațiul este extrem de dinamic, dar în general implică scalarea contextului pe 2 vectori:

1. Lungimea contextului: provocările computaționale și arhitecturale ale procesării secvențelor ultra-lungi

2. Multimodal: scalarea contextului dincolo de text în medii cu adevărat multimodale.

8) Poate că expresia finală a contextului eng. este crearea de "medii RL" care imită perfect sarcinile pe care RL poate fi rulat.

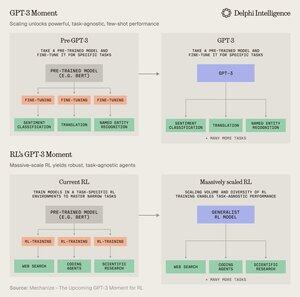

Deși datele sunt limitate astăzi, @MechanizeWork crede că ne îndreptăm spre o inflexiune "GPT-3-esque" cu RL la scară masivă

9) Cu toate acestea, crearea acestor medii necesită destul de multă muncă și nu pare foarte "amară".

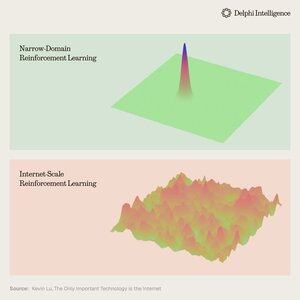

@_kevinlu se întreabă dacă există o modalitate de a valorifica internetul pentru post-instruire, așa cum s-a făcut pentru pre-instruire?

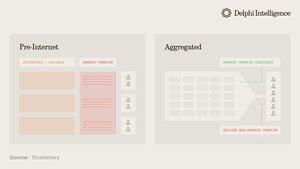

10) Deși este un gând interesant, o mare parte din internet a fost capturată de câteva ecosisteme mari care sunt integrate vertical și conduc rapid RL în ingredientele lor pentru RL și mai rapid

(adică alfa evoluează din @GoogleDeepMind )

11) Nu este clar dacă aceste companii mari văd mediile RL disparate ca fiind esențiale sau doar o oprire temporară în drumul către "modele mondiale" complete, complete cu gemeni digitali ai aproape fiecărui fenomen

Genie 3 de la Google este cu siguranță un semn în această direcție:

5 aug. 2025

Cum ar fi dacă ai putea nu numai să vizionezi un videoclip generat, ci și să-l explorezi? 🌐

Genie 3 este modelul nostru revoluționar de lume care creează medii interactive, jucabile dintr-o singură solicitare de text.

De la peisaje fotorealiste la tărâmuri fantastice, posibilitățile sunt nesfârșite. 🧵

12) Ceea ce ridică întrebarea: sunt abordările integrate pe verticală pentru construirea inteligenței sintetice cu bucle de feedback RL mai rapide destinate să accelereze și să captureze piața sau pot sistemele modulare de calcul latent, date și talent să concureze cu orchestrarea eficientă?

13,45K

Limită superioară

Clasament

Favorite